Ta vodnik bo prikazal postopek izvajanja LLMChains v LangChain.

Kako zagnati LLMChains v LangChain?

LangChain ponuja funkcije ali odvisnosti za gradnjo LLMChains z uporabo LLM/Chatbotov in predlog pozivov. Če se želite naučiti postopka gradnje in izvajanja LLMChains v LangChain, preprosto sledite naslednjemu vodniku po korakih:

1. korak: Namestite pakete

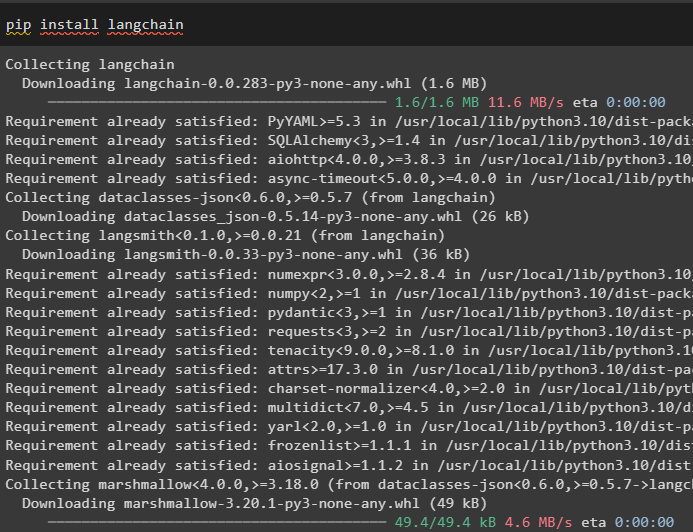

Najprej začnite s postopkom z namestitvijo modula LangChain, da pridobite njegove odvisnosti za izdelavo in izvajanje LLMChains:

pip namestite langchain

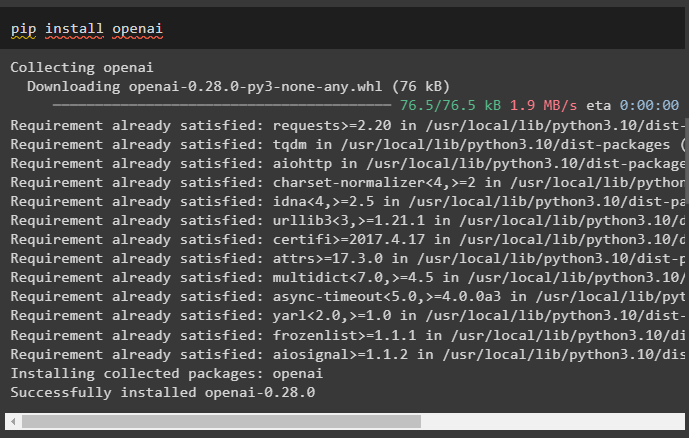

Namestite ogrodje OpenAI z ukazom pip, da pripravite knjižnice do uporabe funkcije OpenAI() za gradnjo LLM-jev:

pip namestite openai

Po namestitvi modulov preprosto nastavite okolje spremenljivke z uporabo ključa API iz računa OpenAI:

uvoz ti

uvoz getpass

ti . približno [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Ključ API OpenAI:' )

2. korak: uvozite knjižnice

Ko je nastavitev končana in so vsi zahtevani paketi nameščeni, uvozite zahtevane knjižnice za izdelavo predloge poziva. Po tem preprosto zgradite LLM z metodo OpenAI() in konfigurirajte LLMChain z uporabo LLM in predloge poziva:

od Langchain uvoz PromptTemplateod Langchain uvoz OpenAI

od Langchain uvoz LLMChain

prompt_template = 'dajte mi dober naslov za podjetje, ki ustvarja {product}?'

llm = OpenAI ( temperaturo = 0 )

llm_veriga = LLMChain (

llm = llm ,

poziv = PromptTemplate. iz_predloge ( prompt_template )

)

llm_veriga ( 'pisana oblačila' )

3. korak: Tekalne verige

Pridobite vhodni seznam, ki vsebuje različne izdelke, ki jih proizvaja podjetje, in zaženite verigo za prikaz seznama na zaslonu:

vhodni_seznam = [{ 'izdelek' : 'nogavice' } ,

{ 'izdelek' : 'računalnik' } ,

{ 'izdelek' : 'čevlji' }

]

llm_veriga. uporabiti ( vhodni_seznam )

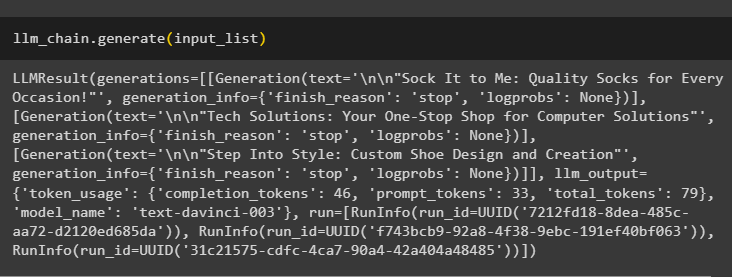

Zaženite metodo generate() z uporabo vhodni_seznam z LLMChains, da dobite izhod, povezan s pogovorom, ki ga ustvari model:

llm_veriga. ustvariti ( vhodni_seznam )

4. korak: Uporaba enega vnosa

Dodajte drug izdelek za zagon LLMChains z uporabo samo enega vhoda in nato predvidite, da bo LLMChain ustvaril izhod:

llm_veriga. napovedati ( izdelek = 'pisane nogavice' )5. korak: Uporaba več vhodov

Zdaj sestavite predlogo za uporabo več vnosov za zagotavljanje ukaza modelu, preden zaženete verigo:

predlogo = '''Povej mi {adjective} šalo o {temi}.'''poziv = PromptTemplate ( predlogo = predlogo , vhodne_spremenljivke = [ 'pridevnik' , 'predmet' ] )

llm_veriga = LLMChain ( poziv = poziv , llm = OpenAI ( temperaturo = 0 ) )

llm_veriga. napovedati ( pridevnik = 'žalosten' , predmet = 'race' )

6. korak: Uporaba izhodnega razčlenjevalnika

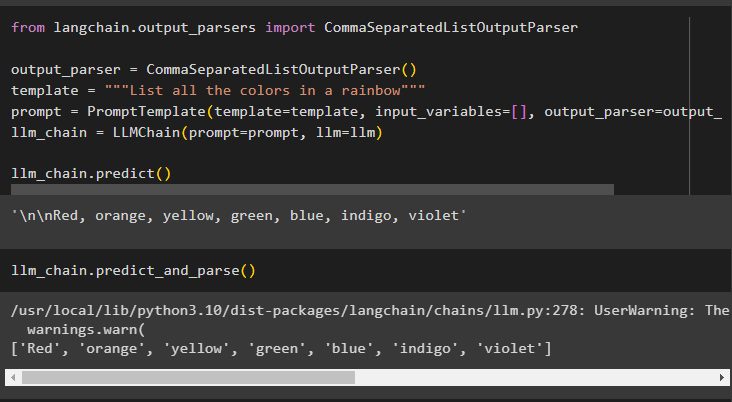

Ta korak uporablja metodo razčlenjevalnika izhoda za zagon LLMChain, da dobi izhod na podlagi poziva:

od Langchain. izhodni_razčlenjevalniki uvoz CommaSeparatedListOutputParserrazčlenjevalnik_izhoda = CommaSeparatedListOutputParser ( )

predlogo = '''Naštej vse barve v mavrici'''

poziv = PromptTemplate ( predlogo = predlogo , vhodne_spremenljivke = [ ] , razčlenjevalnik_izhoda = razčlenjevalnik_izhoda )

llm_veriga = LLMChain ( poziv = poziv , llm = llm )

llm_veriga. napovedati ( )

Uporaba metode parse() za pridobitev izhoda bo ustvarila z vejicami ločen seznam vseh barv v mavrici:

llm_veriga. napoved_in_razčlenitev ( )

7. korak: Inicializacija iz nizov

Ta korak pojasnjuje postopek uporabe niza kot poziva za zagon LLMChain z uporabo modela in predloge LLM:

predlogo = '''Povej mi {adjective} šalo o {temi}'''llm_veriga = LLMChain. iz_niza ( llm = llm , predlogo = predlogo )

Podajte vrednosti spremenljivk v pozivu za niz, da dobite izhod iz modela z zagonom LLMChain:

llm_veriga. napovedati ( pridevnik = 'žalosten' , predmet = 'race' )To je vse o izvajanju LLMChains z uporabo ogrodja LangChain.

Zaključek

Če želite zgraditi in zagnati LLMChains v LangChain, namestite predpogoje, kot so paketi, in nastavite okolje s ključem API OpenAI. Po tem uvozite zahtevane knjižnice za konfiguracijo predloge poziva in modela za izvajanje LLMChain z uporabo odvisnosti LangChain. Uporabnik lahko uporabi izhodne razčlenjevalnike in nizovne ukaze za zagon LLMChains, kot je prikazano v vodniku. Ta vodnik podrobneje opisuje celoten postopek izvajanja LLMChains v LangChain.