Kako uporabljati okno medpomnilnika pogovorov v LangChainu?

Okno medpomnilnika pogovorov se uporablja za shranjevanje najnovejših sporočil pogovora v pomnilniku, da dobite najnovejši kontekst. Uporablja vrednost K za shranjevanje sporočil ali nizov v pomnilnik z uporabo ogrodja LangChain.

Če želite izvedeti postopek uporabe okna medpomnilnika pogovorov v LangChainu, preprosto preberite ta vodnik:

1. korak: Namestite module

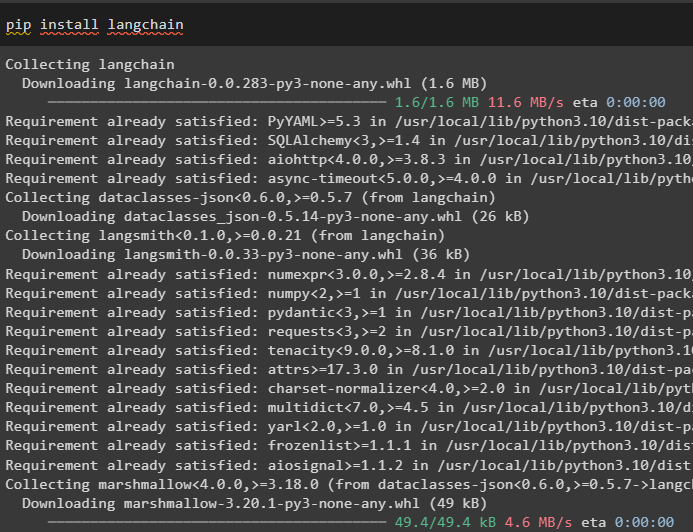

Začnite postopek uporabe pogovornega medpomnilnika z namestitvijo modula LangChain z zahtevanimi odvisnostmi za gradnjo pogovornih modelov:

pip namestite langchain

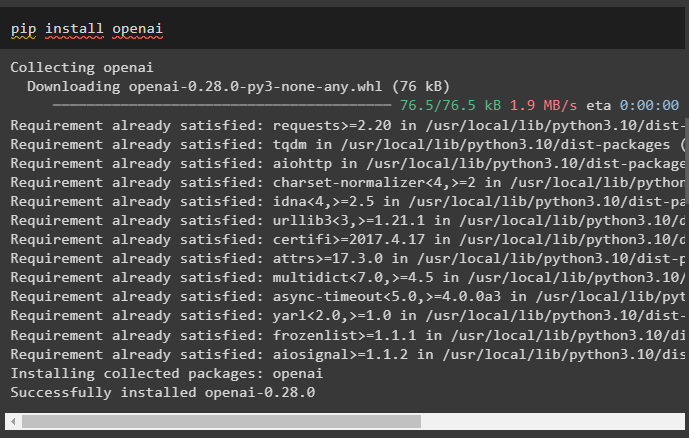

Po tem namestite modul OpenAI, ki ga lahko uporabite za gradnjo velikih jezikovnih modelov v LangChain:

pip namestite openai

zdaj, nastavite okolje OpenAI za izgradnjo verig LLM z uporabo ključa API iz računa OpenAI:

uvoz ti

uvoz getpass

ti . približno [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'Ključ API OpenAI:' )

2. korak: Uporaba pomnilnika okna medpomnilnika pogovorov

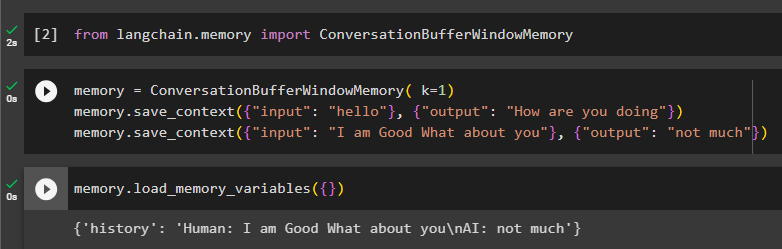

Če želite uporabiti pomnilnik okna medpomnilnika pogovorov v LangChain, uvozite ConversationBufferWindowMemory knjižnica:

od Langchain. spomin uvoz ConversationBufferWindowMemoryKonfigurirajte pomnilnik z uporabo ConversationBufferWindowMemory () z vrednostjo k kot argumentom. Vrednost k bo uporabljena za shranjevanje najnovejših sporočil iz pogovora in nato konfiguracijo podatkov o usposabljanju z uporabo vhodnih in izhodnih spremenljivk:

spomin = ConversationBufferWindowMemory ( k = 1 )spomin. shrani_kontekst ( { 'vnos' : 'zdravo' } , { 'izhod' : 'Kako si' } )

spomin. shrani_kontekst ( { 'vnos' : 'Dober sem, kaj pa ti' } , { 'izhod' : 'ne veliko' } )

Preizkusite pomnilnik tako, da pokličete load_memory_variables () metoda za začetek pogovora:

spomin. load_memory_variables ( { } )

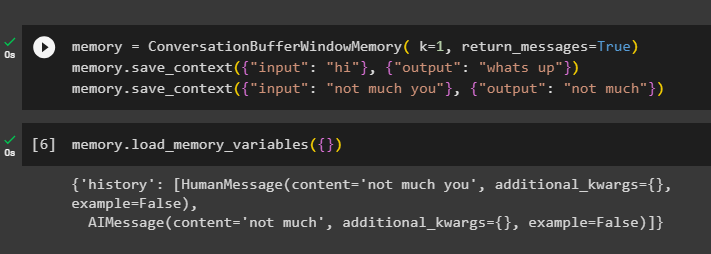

Če želite pridobiti zgodovino pogovora, konfigurirajte funkcijo ConversationBufferWindowMemory() z uporabo povratna_sporočila prepir:

spomin = ConversationBufferWindowMemory ( k = 1 , povratna_sporočila = Prav )spomin. shrani_kontekst ( { 'vnos' : 'zdravo' } , { 'izhod' : 'kaj se dogaja' } )

spomin. shrani_kontekst ( { 'vnos' : 'ne preveč Ti' } , { 'izhod' : 'ne veliko' } )

Zdaj pokličite pomnilnik z uporabo load_memory_variables () metoda za pridobitev odgovora z zgodovino pogovora:

spomin. load_memory_variables ( { } )

3. korak: Uporaba okna medpomnilnika v verigi

Zgradite verigo z uporabo OpenAI in ConversationChain knjižnice in nato konfigurirajte vmesni pomnilnik za shranjevanje najnovejših sporočil v pogovoru:

od Langchain. verige uvoz ConversationChainod Langchain. llms uvoz OpenAI

#sestavljanje povzetka pogovora z uporabo več parametrov

pogovor_s_povzetkom = ConversationChain (

llm = OpenAI ( temperaturo = 0 ) ,

#building pomnilniški medpomnilnik z uporabo njegove funkcije z vrednostjo k za shranjevanje zadnjih sporočil

spomin = ConversationBufferWindowMemory ( k = 2 ) ,

#configure verbose spremenljivka za bolj berljiv rezultat

verbose = Prav

)

pogovor_s_povzetkom. napovedati ( vnos = 'Živjo, kaj dogaja' )

Zdaj nadaljujte pogovor tako, da postavite vprašanje v zvezi z rezultatom, ki ga zagotavlja model:

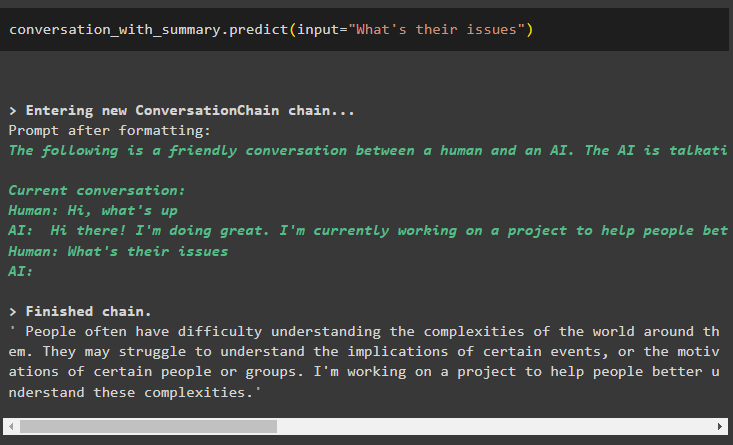

pogovor_s_povzetkom. napovedati ( vnos = 'Kakšne so njihove težave' )

Model je konfiguriran za shranjevanje samo enega prejšnjega sporočila, ki se lahko uporabi kot kontekst:

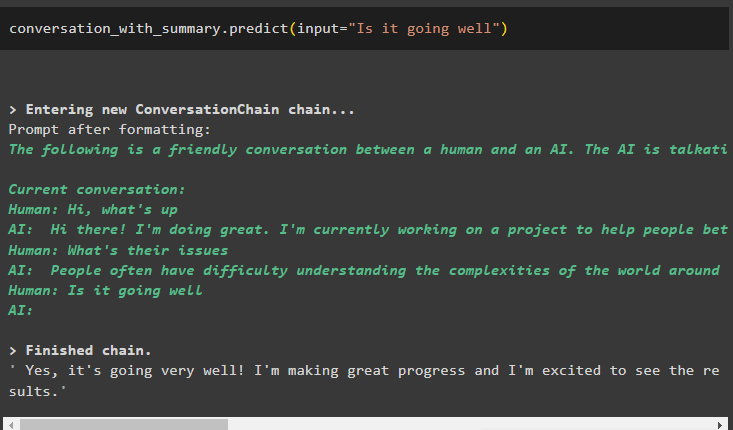

pogovor_s_povzetkom. napovedati ( vnos = 'Ali gre dobro' )

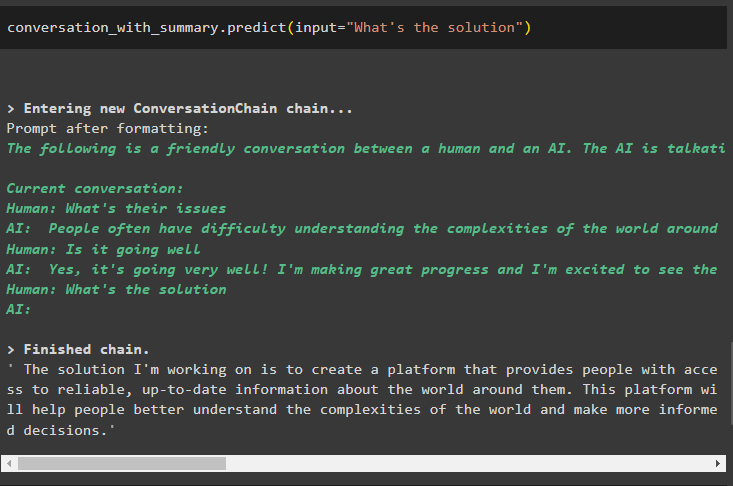

Vprašajte za rešitev težav in izhodna struktura bo še naprej premikala okno medpomnilnika tako, da bo odstranila prejšnja sporočila:

pogovor_s_povzetkom. napovedati ( vnos = 'Kaj je rešitev' )

To je vse o postopku uporabe medpomnilnika pogovorov Windows LangChain.

Zaključek

Če želite uporabiti pomnilnik okna medpomnilnika pogovorov v LangChain, preprosto namestite module in nastavite okolje s ključem API OpenAI. Po tem zgradite vmesni pomnilnik z uporabo vrednosti k, da obdržite najnovejša sporočila v pogovoru, da ohranite kontekst. Vmesni pomnilnik se lahko uporablja tudi z verigami za sprožitev pogovora z LLM ali verigo. Ta priročnik je podrobneje predstavil postopek uporabe okna medpomnilnika pogovorov v LangChain.