Ta članek ponuja vodnik po korakih o uporabi tokenizatorjev v Hugging Face Transformers.

Kaj je Tokenizer?

Tokenizer je pomemben koncept NLP, njegov glavni cilj pa je pretvoriti neobdelano besedilo v številke. V ta namen obstajajo različne tehnike in metodologije. Vendar je treba omeniti, da vsaka tehnika služi določenemu namenu.

Kako uporabiti tokenizatorje v transformatorjih objemajočih obrazov?

Kako uporabiti tokenizatorje v transformatorjih objemajočih obrazov?

Knjižnico tokenizerja morate najprej namestiti, preden jo uporabite in iz nje uvozite funkcije. Nato usposobite model z uporabo AutoTokenizerja in nato zagotovite vnos za izvedbo tokenizacije.

Hugging Face uvaja tri glavne kategorije tokenizacije, ki so navedene spodaj:

- Besedni Tokenizer

- Tokenizer na osnovi znakov

- Tokenizer na podlagi podbesed

Tukaj je vodnik po korakih za uporabo Tokenizers v Transformers:

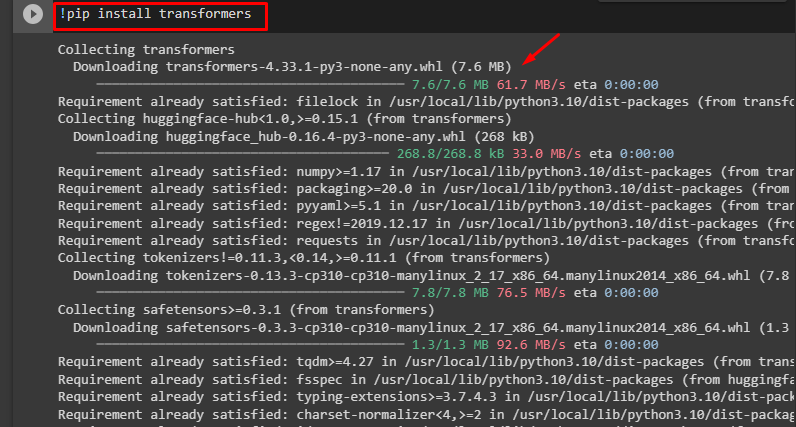

1. korak: Namestite transformatorje

Če želite namestiti transformatorje, uporabite ukaz pip v naslednjem ukazu:

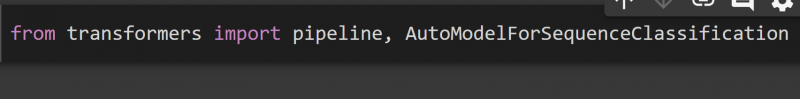

2. korak: uvozite razrede

Od transformatorjev, uvoz cevovod , in AutoModelForSequenceClassification knjižnica za izvedbo klasifikacije:

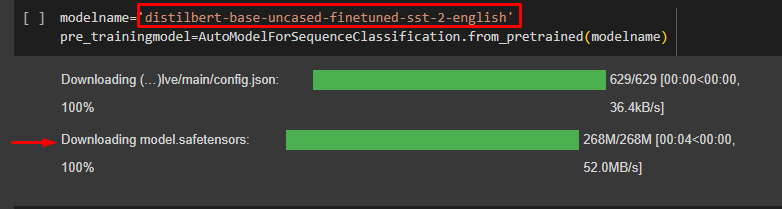

3. korak: Uvozite model

' AutoModelForSequenceClassification ” je metoda, ki spada v Auto-Class za tokenizacijo. The from_pretrained() metoda se uporablja za vrnitev pravilnega razreda modela glede na tip modela.

Tukaj smo navedli ime modela v ' ime modela ” spremenljivka:

ime modela = 'distilbert-base-uncased-finetuned-sst-2-english'pre_trainingmodel =AutoModelForSequenceClassification.from_pretrained ( ime modela )

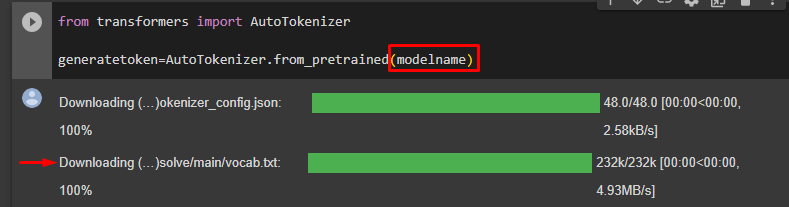

4. korak: uvozite AutoTokenizer

Podajte naslednji ukaz za generiranje žetonov s posredovanjem » ime modela « kot argument:

ustvarjeni žeton =AutoTokenizer.from_pretrained ( ime modela )

5. korak: Ustvarite žeton

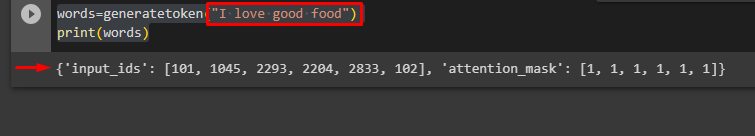

Zdaj bomo ustvarili žetone na stavku “Obožujem dobro hrano” z uporabo ' ustvarjeni žeton ” spremenljivka:

tiskanje ( besede )

Izhod je podan na naslednji način:

Koda za zgoraj Google Co je podana tukaj.

Zaključek

Če želite uporabiti tokenizatorje v Hugging Face, namestite knjižnico z ukazom pip, usposobite model z uporabo AutoTokenizerja in nato zagotovite vnos za izvedbo tokenizacije. Z uporabo tokenizacije dodelite uteži besedam, na podlagi katerih so zaporedne, da ohranite pomen stavka. Ta ocena tudi določa njihovo vrednost za analizo. Ta članek je podroben vodnik o uporabi tokenizatorjev v Hugging Face Transformers.