Funkcija pipeline() je sestavni del knjižnice Transformer. Potrebuje več vnosov, v katerih lahko definiramo nalogo sklepanja, modele, mehanizem tokenizacije itd. Funkcija pipeline() se večinoma uporablja za izvajanje nalog NLP na enem ali več besedilih. Izvaja predhodno obdelavo vnosa in naknadno obdelavo na podlagi modela, da ustvari človeku berljiv izhod in natančno napoved z največjo natančnostjo.

Ta članek obravnava naslednje vidike:

- Kaj je knjižnica naborov podatkov o objemajočih se obrazih?

- Kako uporabiti cevovode na naboru podatkov v Hugging Face?

Kaj je knjižnica nabora podatkov o objemajočih se obrazih?

Knjižnica nabora podatkov Hugging Face je API, ki vsebuje več javnih naborov podatkov in omogoča enostaven način za njihov prenos. To knjižnico lahko uvozite in namestite v aplikacijo z uporabo » pip ” ukaz. Za praktično predstavitev prenosa in namestitve naborov podatkov knjižnice Hugging Face obiščite tole Povezava Google Colab. Prenesete lahko več naborov podatkov iz Hugging Face Dataset Hub.

Več o delovanju funkcije pipeline() lahko preberete v tem članku “ Kako uporabiti funkcijo Pipeline() v transformatorjih? ”.

Kako uporabiti cevovode na naboru podatkov v Hugging Face?

Hugging Face ponuja več različnih javnih naborov podatkov, ki jih je mogoče preprosto namestiti z enovrstično kodo. V tem članku si bomo ogledali praktično predstavitev uporabe cevovodov za te nize podatkov. Obstajata dva načina, na katera je mogoče cevovode implementirati v nabor podatkov.

Metoda 1: Uporaba metode ponovitve

Funkcijo pipeline() je mogoče ponavljati tudi po naboru podatkov in modelu. V ta namen sledite spodaj navedenim korakom:

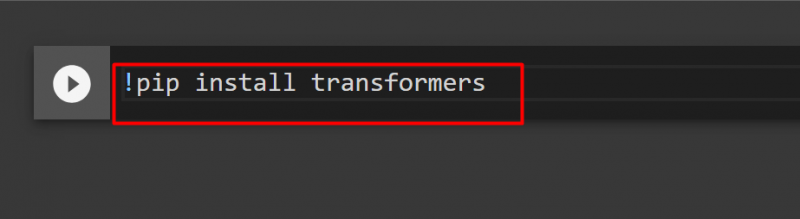

1. korak: Namestite Transformer Library

Če želite namestiti knjižnico Transformer, vnesite naslednji ukaz:

!pip namestite transformatorje

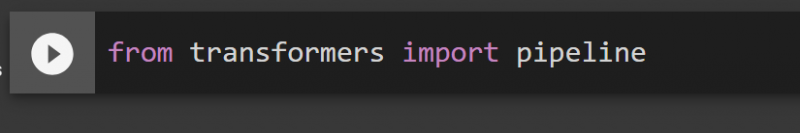

2. korak: Uvozite cevovode

Cevovod lahko uvozimo iz knjižnice Transformer. V ta namen podajte naslednji ukaz:

iz uvoznega cevovoda transformatorjev

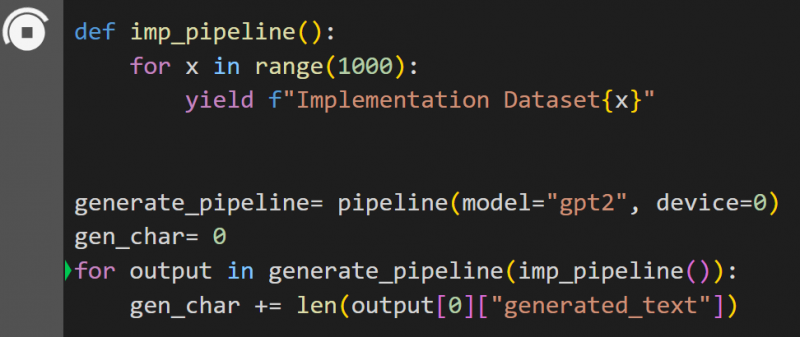

3. korak: Izvedite cevovod

Tu je funkcija pipeline() implementirana na modelu ' gpt2 ”. Modele lahko prenesete iz Hugging Face Model Hub:

def imp_pipeline():za x v območju (1000):

yield f'Implementation Dataset{x}'

generate_pipeline=cevovod(model='gpt2', naprava=0)

gen_char= 0

za izhod v generate_pipeline(imp_pipeline()):

gen_char += len(output[0]['generated_text'])

V tej kodi je » generiraj_cevovod ' je spremenljivka, ki vsebuje funkcijo pipeline() z modelom ' gpt2 ”. Ko je poklican z ' imp_pipeline() ” samodejno prepozna podatke, ki so povečani z obsegom, določenim na 1000:

To bo trajalo nekaj časa za usposabljanje. Povezava do Google Co je tudi podana.

2. način: Uporaba knjižnice naborov podatkov

V tej metodi bomo prikazali izvajanje cevovoda z uporabo knjižnice »naborov podatkov«:

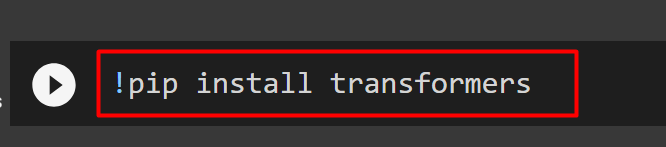

1. korak: Namestite Transformer

Če želite namestiti knjižnico Transformer, vnesite naslednji ukaz:

!pip namestite transformatorje

2. korak: Namestite knjižnico nabora podatkov

Kot ' nabori podatkov ” vsebuje vse javne nabore podatkov, jo lahko namestimo z naslednjim ukazom. Z namestitvijo » nabori podatkov ”, lahko neposredno uvozimo kateri koli nabor podatkov tako, da vnesemo njegovo ime:

!pip namestite nize podatkov

3. korak: Cevovod nabora podatkov

Če želite zgraditi cevovod na naboru podatkov, uporabite naslednjo kodo. KeyDataset je funkcija, ki izpiše samo tiste vrednosti, ki zanimajo uporabnika:

iz transformers.pipelines.pt_utils uvozite KeyDatasetiz uvoznega cevovoda transformatorjev

iz naborov podatkov uvozi load_dataset

gen_pipeline = cevovod (model='hf-internal-testing/tiny-random-wav2vec2', naprava=0)

loaddataset = load_dataset('hf-internal-testing/librispeech_asr_dummy', 'clean', split='validation[:10]')za izhod v gen_pipeline(KeyDataset(loaddataset, 'audio')):

print('Tiskanje izpisa zdaj')

natisni ('----------------')

izpis (izpis)

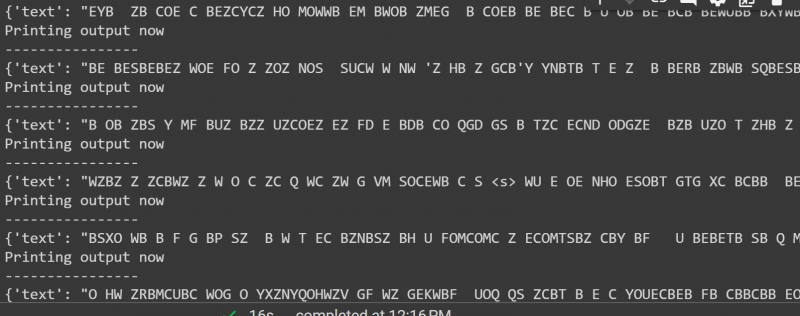

Izhod zgornje kode je podan spodaj:

To je vse iz tega vodnika. Povezava do Google Co je omenjen tudi v tem članku

Zaključek

Za uporabo cevovodov v naboru podatkov lahko bodisi ponovimo nabor podatkov s funkcijo pipeline() ali uporabimo » nabori podatkov ' knjižnica. Hugging Face svojim uporabnikom zagotavlja povezavo do repozitorija GitHub za nabore podatkov in modele, ki jih je mogoče uporabiti glede na zahteve. Ta članek je zagotovil izčrpen vodnik za uporabo cevovodov na naboru podatkov v Transformers.